简介

目前 Star 7.1K

官方地址:https://github.com/Huanshere/VideoLingo

Netflix级字幕切割、翻译、对齐、甚至加上配音,一键全自动视频搬运AI字幕组

VideoLingo 是一站式视频翻译本地化配音工具,能够一键生成 Netflix 级别的高质量字幕,告别生硬机翻,告别多行字幕,还能加上高质量的克隆配音,让全世界的知识能够跨越语言的障碍共享。

主要特点和功能:

🎥 使用 yt-dlp 从 Youtube 链接下载视频

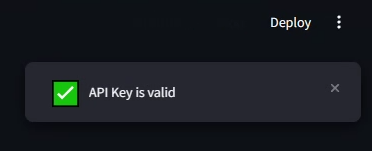

🎙️ 使用 WhisperX 进行单词级时间轴字幕识别

📝 使用 NLP 和 GPT 根据句意进行字幕分割

📚 GPT 总结提取术语知识库,上下文连贯翻译

🔄 三步直译、反思、意译,媲美字幕组精翻效果

✅ 按照 Netflix 标准检查单行长度,绝无双行字幕

🗣️ 使用 FishTTS 等方法对齐克隆配音

🚀 整合包一键启动,在 streamlit 中一键出片

📝 详细记录每步操作日志,支持随时中断和恢复进度

与同类项目相比的优势:绝无多行字幕,最佳的翻译质量,无缝的配音体验

语言支持

输入语言支持:

🇺🇸 英语 🤩 | 🇷🇺 俄语 😊 | 🇫🇷 法语 🤩 | 🇩🇪 德语 🤩 | 🇮🇹 意大利语 🤩 | 🇪🇸 西班牙语 🤩 | 🇯🇵 日语 😐 | 🇨🇳 中文* 😊

总结

效果牛B,但坑贼多,缝合怪...

字幕可二次修改,配音可自定义,自己训练模型,例如,方块猴的声音等...

10分钟视频, 处理时间大概7分钟左右。

效果展示

涉及公司内容,隐藏了

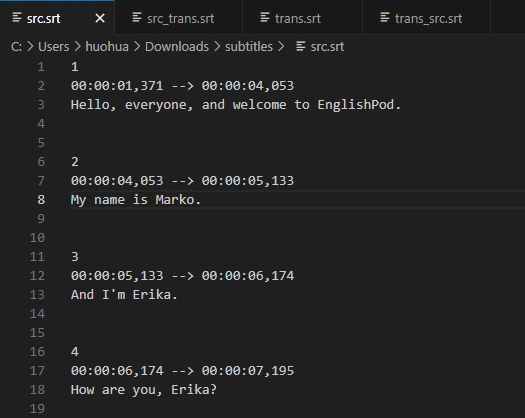

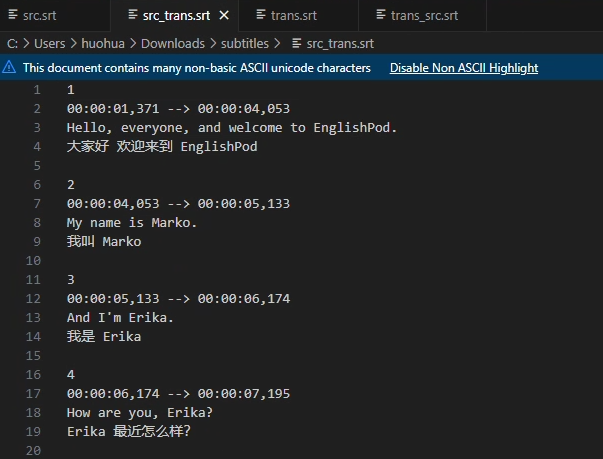

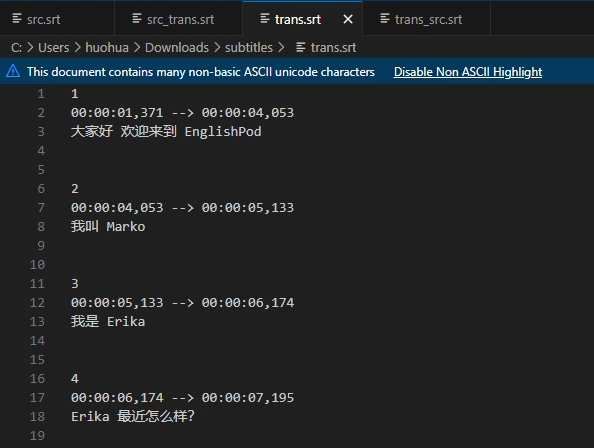

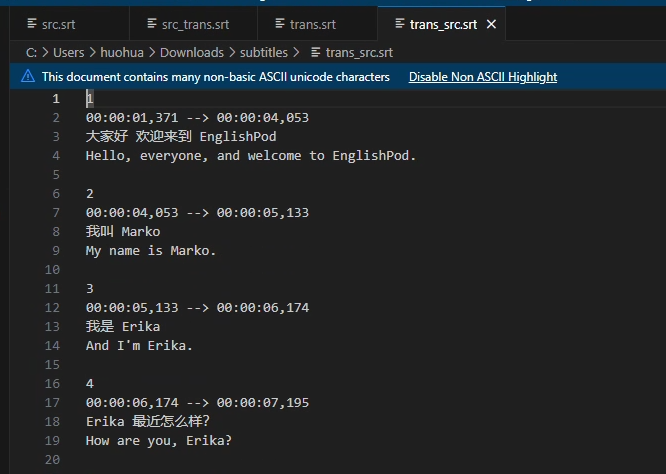

字幕分离

提供4组数据 , 中文,英文,中英对照,英中对照。

使用方法

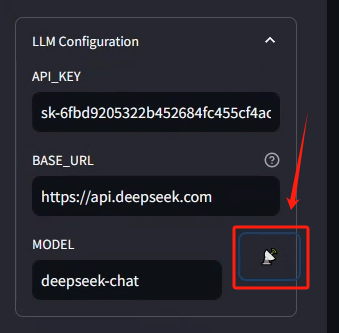

添加 LLM 语言参数

点击测试

部署

拉取项目 https://github.com/Huanshere/VideoLingo

安装依赖

本地创建python 环境, 要求 3.10

python -m venv venv

添加模型

继续补依赖

python install.py

GPT-SoVITS-v2 安装

https://www.icloud.com/iclouddrive/0fejFggjP4AgBHXlxz2DLJ71w#GPT-SoVITS-v2-240821

启动

Streamlit 启动

坑

这个项目是个缝合怪,碰到的坑。比我吃过的饭都多....

要求贼苛刻...

环境变量

最低要求:

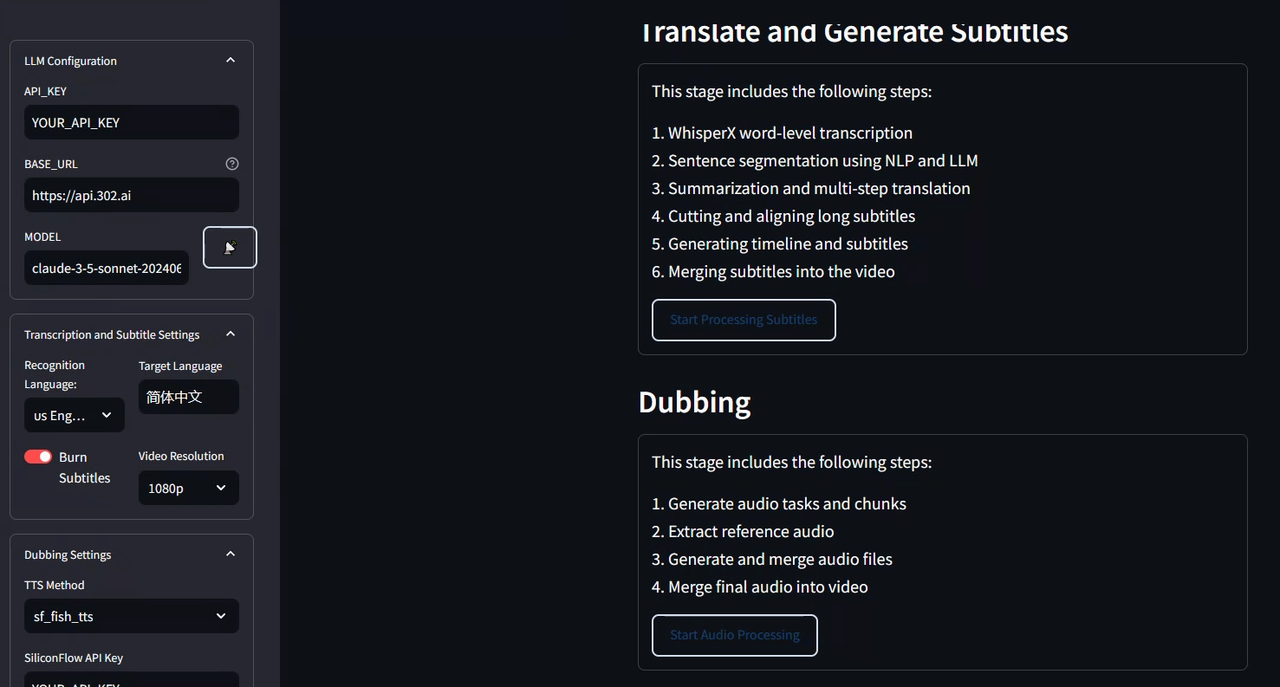

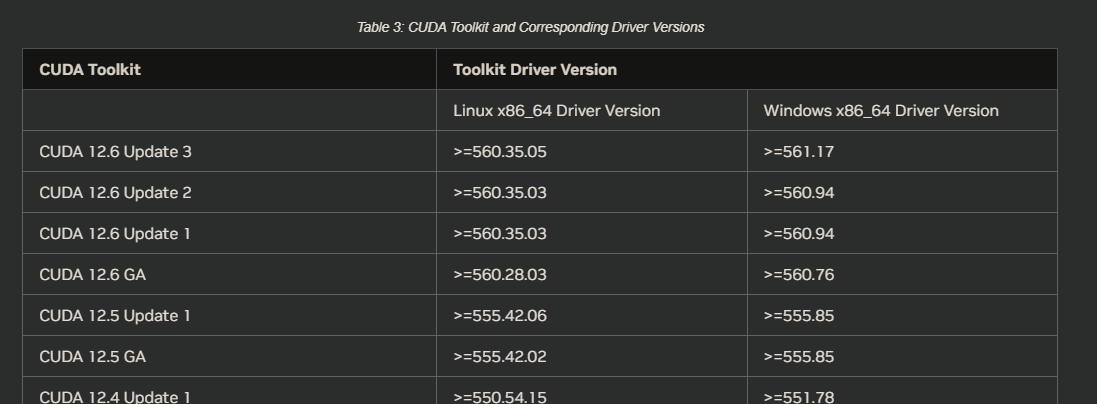

CUDA Toolkit 12.6 - 必须

CUDNN 9.3.0 - 必须

Python 虚拟环境 - 必须 3.10.0

Wav 模型,wav2vec2_fairseq_base_ls960_asr_ls960.pth 必须 HuggingFace 下。别的位置的不兼容。

Python en_core_web_md 库,github 下。

python -m spacy validate 查看版本

modelcache 模型,名字要自己修改,默认的识别不到。参看 Config

Failed reading zip ,pth模型损坏。

whisper模型 官方给出是HuggingFace 名称,根据代码反推,实际是github 名称。

基础包 CUDA Toolkit 、CUDNN

CUDA Toolkit 12.6:https://developer.download.nvidia.com/compute/cuda/12.6.0/local_installers/cuda_12.6.0_560.76_windows.exe

CUDNN 9.3.0:https://developer.download.nvidia.com/compute/cudnn/9.3.0/local_installers/cudnn_9.3.0_windows.exe

显卡配置相关。

https://docs.nvidia.com/cuda/cuda-toolkit-release-notes/index.html

https://developer.nvidia.com/cuda-toolkit-archive

根据driver 版本下载对应 toolkit 版本